Nachrichten

Der KI-Trend hat möglicherweise die kommenden Chips von AMD und Intel beeinträchtigt: Strix-APUs verfügten ursprünglich über einen großen Cache, der die CPU- und iGPU-Leistung steigerte

Der jüngste KI-Trend hat möglicherweise einige kommende SOCs geschwächt, da Chiphersteller wie AMD und Intel der NPU Vorrang vor anderen Kern-IPs einräumen.

Die Forderung von Microsoft nach schnelleren KI-Funktionen führt zu erheblichen SOC-Einbußen im gesamten AMD- und Intel-Lager, da NPUs Vorrang vor anderen Aspekten haben

Wir haben kürzlich eine KI-Explosion im PC-Segment erlebt, bei der alle Chiphersteller über die jeweiligen Fähigkeiten ihrer Chips und Plattformen sprachen. Das Segment wird durch eine Reihe von Softwareinnovationen und Microsofts Windows Copilot vorangetrieben, der hohe Anforderungen an die Unterstützung seiner KI-Funktionalität stellt. Chiphersteller setzen jetzt stark auf den KI-Wahn und es sieht so aus, als ob einige von ihren traditionellen Chip-Entwicklungsplänen abgekommen sind und der KI Vorrang vor anderen Teilen ihrer neuesten SOCs einräumen, die später in diesem Jahr auf den Markt kommen werden.

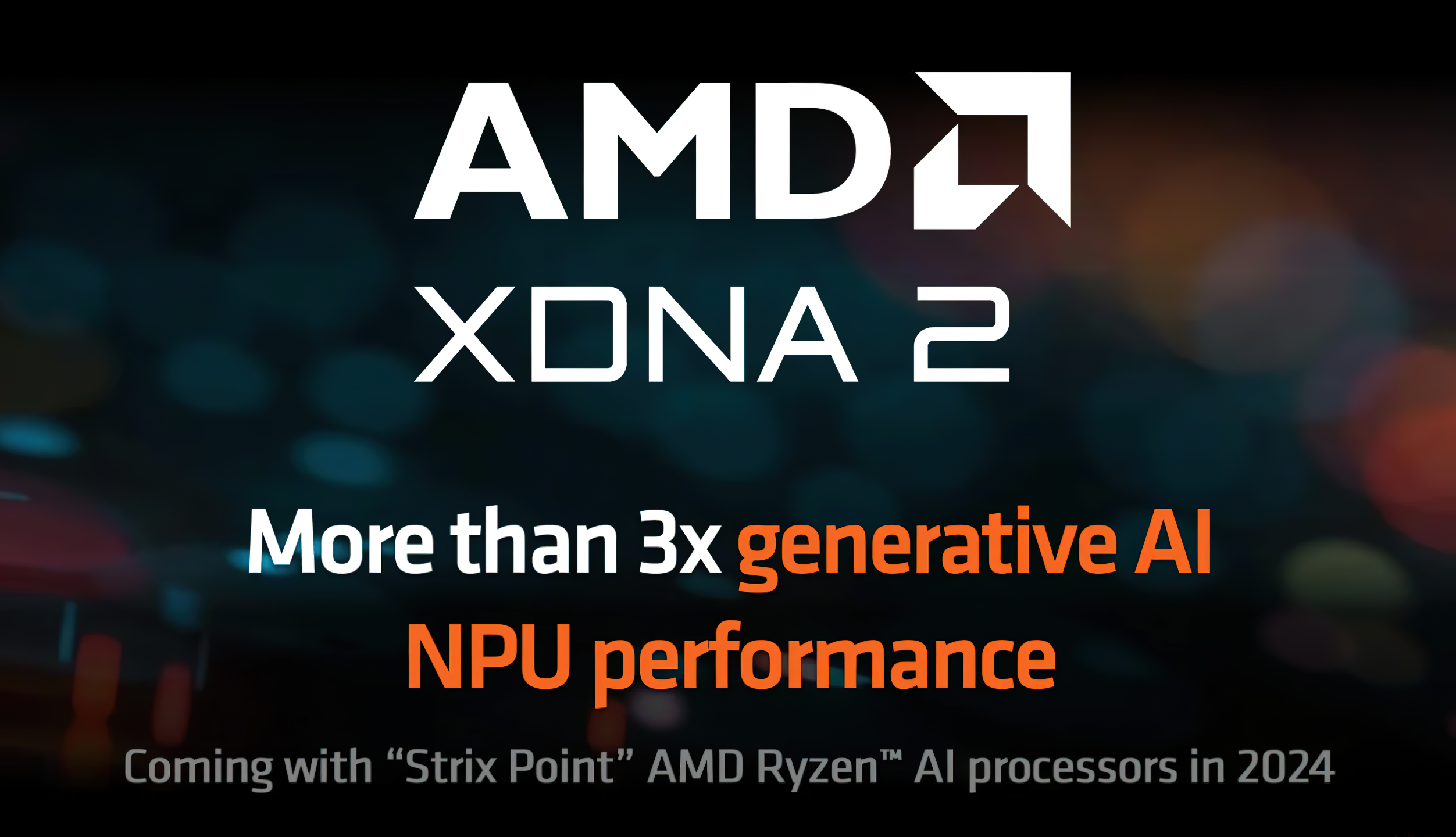

Bei Anandtech-Foren, es wird von Mitglied Uzzi38 berichtet, dass AMDs Strix Point APUs, die später in diesem Jahr auf den Markt kommen, ursprünglich ganz anders sein sollten als die Chips, die wir bald bekommen werden. Es wird behauptet, dass der Chip einen großen SLC (System-Level-Cache) hatte, bevor AMD einen großen AI-Engine-Block für die KI-Leistung der 3x NPU „XDNA 2“ reservierte, was die Leistung beider CPUs (Zen 5) erhöht hätte ) und iGPU (RDNA 3+) mit großem Abstand. Das passiert jedoch nicht mehr.

Ein Folgekommentar zu dieser Angelegenheit wurde von abgegeben adroc_thurston der Uzzi antwortete, dass Strix 1 oder Strix Point monolithisch einmal über 16 MB MALL-Cache verfügten, bevor dieser gelöscht wurde. Intel hat auch viel in die kommenden Chips Arrow Lake, Lunar Lake und Panther Lake investiert, die auf das KI-PC-Segment abzielen.

Diese KI-Blöcke werden große Teile des wertvollen Chip-Platzes beanspruchen, der woanders hätte eingesetzt werden können, wie zum Beispiel höhere Kernzahlen, höhere iGPU-Zahlen, breitere Caches und mehr, aber es sieht so aus, als ob die KI-PC-Begeisterung die Chiphersteller dazu gebracht hat, den Standard in den Hintergrund zu rücken CPU-/iGPU-Leistung verbessern und sich mehr auf die NPU-Seite konzentrieren. Für Strix Point hat AMD einen dreifachen Gewinn mit bis zu 50 TOPs angekündigt, während Lunar Lake eine dreifache KI-NPU-Leistung gegenüber Meteor Lake bieten wird (~35 TOPs) und Panther Lake diese noch weiter verdoppeln wird (~70 TOPs).

Im Moment sieht es so aus, als würden Chiphersteller wie AMD und Intel bis zum Platzen der KI-Blase (was nicht so schnell passieren dürfte) Ressourcen für die Einführung schnellerer NPUs aufwenden. Wir werden immer noch Verbesserungen auf der CPU- und GPU-Seite für SOCs der nächsten Generation sehen, aber es wird immer das ungenutzte Potenzial geben, das hätte entstehen können, wenn sich diese Unternehmen auf andere Dinge als die NPU konzentriert hätten.

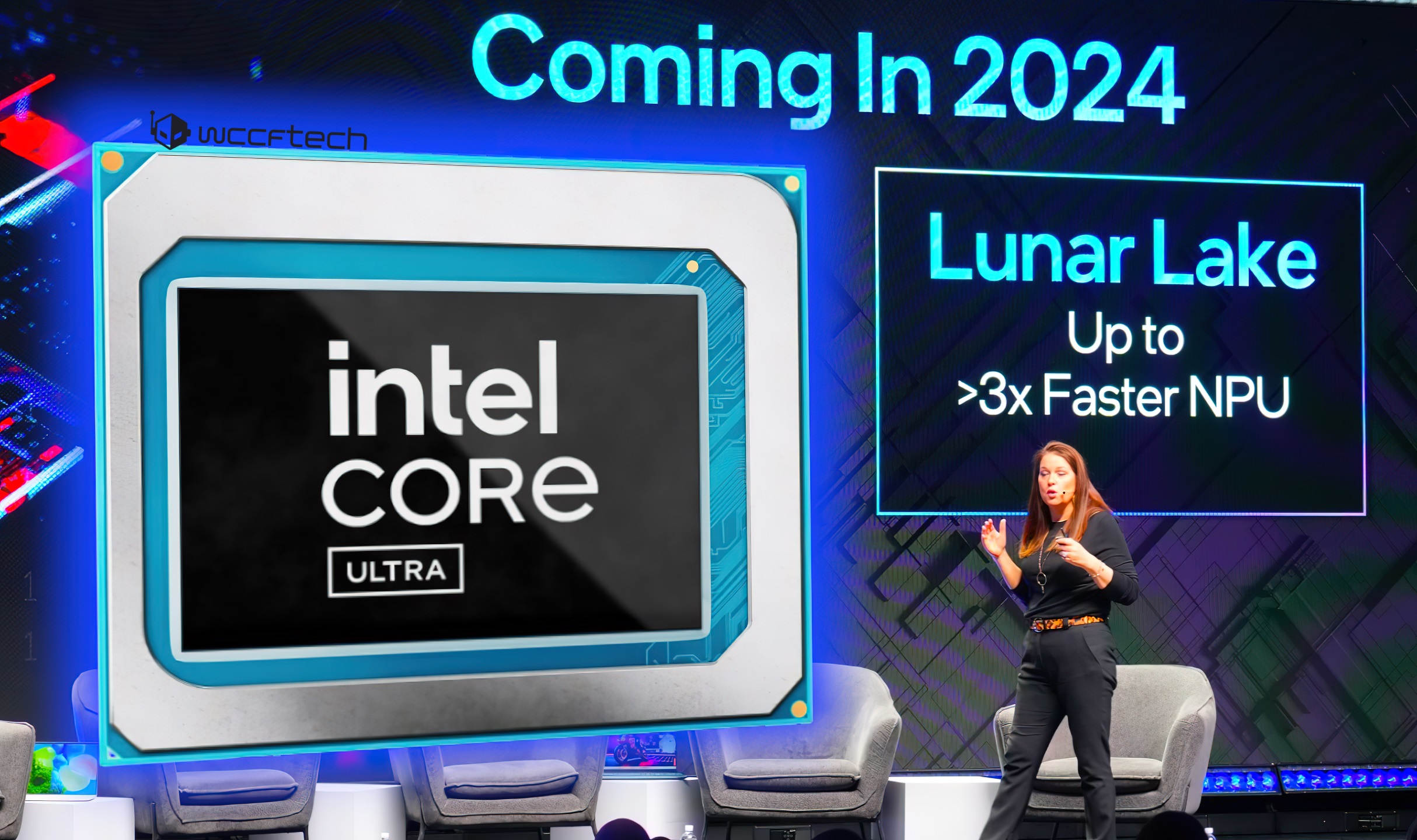

2024 KI-PC-Plattformen

| Markenname | Apfel | Qualcomm | AMD | Intel |

|---|---|---|---|---|

| CPU-Name | M3 | Snapdragon X Elite | Ryzen 8040 „Hawk Point“ | Meteorsee „Core Ultra“ |

| CPU-Architektur | ARM | ARM | x86 | x86 |

| CPU-Prozess | 3nm | 4nm | 4nm | 7 nm (Intel 4) |

| Maximale CPU-Kerne | 16 Kerne (MAX) | 12 Kerne | 8 Kerne | 16 Kerne |

| NPU-Architektur | Inhouse | Sechseck-NPU | XDNA 1 NPU | Movidius NPU |

| Insgesamt KI TOPS | 18 TOPS | 75 TOPS (Spitze) | 38 TOPS (16 TOPS NPU) | 34 TOPS (11 TOPS NPU) |

| GPU-Architektur | Inhouse | Adreno-GPU | RDNA 3 | Alchemist Arc Xe-LPG |

| Maximale GPU-Kerne | 40 Kerne | Noch offen | 12 Recheneinheiten | 8 Xe-Kerne |

| GPU-TFLOPs | Noch offen | 4,6 TFLOPS | 8,9 TFLOPS | ~4,5 TFLOPS |

| Speicherunterstützung (max.) | LPDDR5-6400 | LPDDR5X-8533 | LPDDR5X-7500 | LPDDR5X-7467 |

| Verfügbarkeit | Q4 2024 | Mitte 2024 | 1. Quartal 2024 | Q4 2023 |