Kryptowährung

Deepfake K-Pop-Pornos, weckte Grok, „OpenAI hat ein Problem“, Fetch.AI: AI Eye

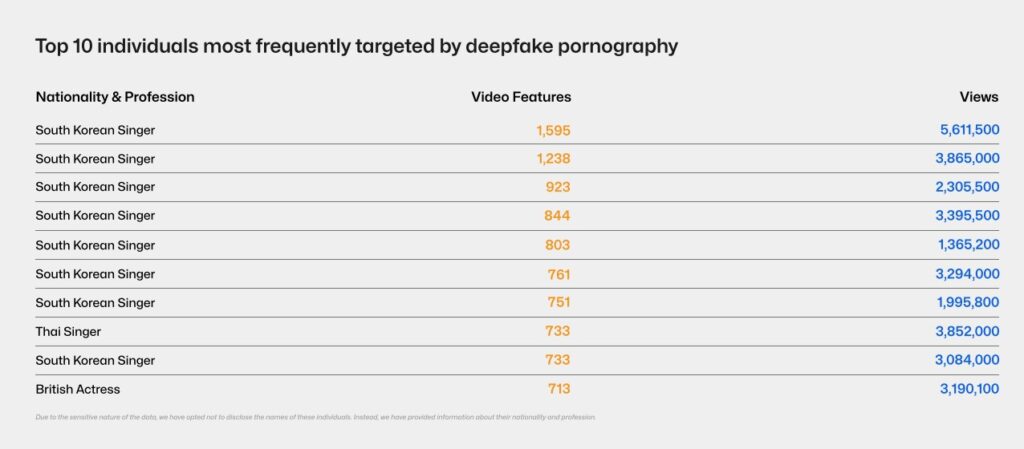

98 % der Deepfakes sind Pornos

Die KI-Bildgenerierung ist in den letzten 12 Monaten unglaublich gut geworden … und einige Leute (hauptsächlich Männer) nutzen die Technologie zunehmend, um hausgemachte Deepfake-Pornos von Menschen zu erstellen, von denen sie träumen, indem sie Bilder aus sozialen Medien verwenden.

Die Untertanen hassen es natürlich, und die Praxis wurde im Vereinigten Königreich verboten. Allerdings gibt es in den Vereinigten Staaten kein Bundesgesetz, das die Erstellung von Deepfakes ohne Zustimmung verbietet.

Mobile Apps zum Face-Swapping wie Reface machen es einfach, ein Bild des Gesichts einer Person auf vorhandene Pornobilder und -videos zu übertragen. KI-Tools wie DeepNude und Nudeify erstellen eine realistische Darstellung dessen, wie das KI-Tool denkt, dass jemand nackt aussieht. Der NSFW-KI-Kunstgenerator kann sogar Anime-Porno-Deepfakes für 9,99 $ pro Monat erstellen.

Laut dem Analyseunternehmen für soziale Netzwerke Graphika gab es allein im September 24 Millionen Besuche auf dieser Art von Websites. „Man kann etwas schaffen, das tatsächlich realistisch aussieht“, erklärt der Analyst Santiago Lakatos.

Beworben werden solche Apps und Seiten vor allem auf Social-Media-Plattformen, die langsam auch aktiv werden. Reddit verbietet die nicht einvernehmliche Weitergabe gefälschter expliziter Bilder und hat mehrere Domains gesperrt, während TikTok und Meta die Suche nach Schlüsselwörtern im Zusammenhang mit „ausziehen“ verboten haben.

Laut einem Bericht von Home Security Heroes sind rund 98 % aller Deepfake-Videos Pornos. Wir können Ihnen keinen davon zeigen, deshalb hier einer von Biden, Boris Johnson und Macro beim Krumpen.

„KI wird die Welt zerstören“

Mittlerweile KI: pic.twitter.com/Rz2UAuOQQS

— Enzo Avigo (@0zne) 11. Dezember 2023

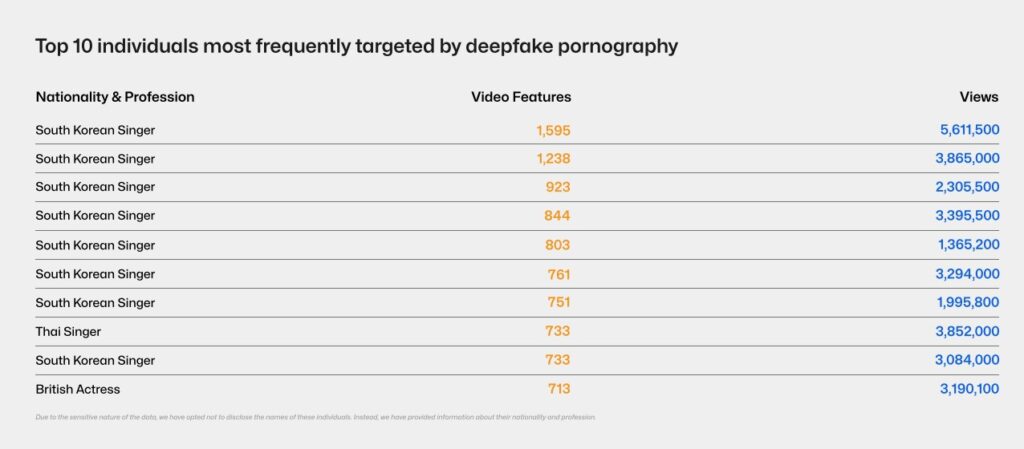

Die technologie- und promibesessenen Südkoreaner sind führend im Trend und machen 53 % aller Deepfake-Pornos im Internet aus.

K-Pop-Sängerinnen (58 %) und Schauspielerinnen aus Südkorea (33 %) bilden die überwiegende Zahl der Zielgruppen, wobei eine Sängerin Gegenstand von 1.595 Videos ist, die mehr als 5,5 Millionen Mal angesehen wurden.

Eine Umfrage unter 1.522 amerikanischen Männern ergab, dass 68 % zwar schockiert und empört über die damit verbundene Verletzung der Privatsphäre und der Einwilligung wären, wenn es sich bei dem Deepfake um jemanden handelte, den sie kennen, dass die tatsächlichen Konsumenten von Deepfake-Pornos jedoch kaum gestört werden. Rund drei Viertel hatten überhaupt kein schlechtes Gewissen.

Grok ist kein Edgelord

Es stellt sich heraus, dass Grok nicht der wahrheitsspuckende Edgelord-Chatbot ist, auf den Elon Musk gehofft hatte.

X versprach, dass Grok „pikante Fragen beantworten würde, die von den meisten anderen KI-Systemen abgelehnt werden“, aber vor Ort beantwortete Grok Fragen genauso wie ChatGPT.

Sie denken, Musks Lieblingssatz, der „Wake-Mind-Virus“, sei „eine Menge Blödsinn“; es heißt, dass Transfrauen Frauen sind (oder das war so, bis der konservative Bericht Ian Miles Cheong es offenbar zur Unterwerfung brachte); Sie unterstützt Joe Biden als Präsidenten aufgrund seines Engagements für soziale Gerechtigkeit und sagt, sie sei nicht besonders angetan von Christen.

Lesen Sie auch

Merkmale

Fan-Token: Daytrading Ihrer Lieblingssportmannschaft

Merkmale

So bereiten Sie sich auf das Ende des Bullenmarktes vor, Teil 1: Timing

Ein politischer Kompasstest ergab, dass Grok im linkslibertären Quadranten des politischen Kompasses liegt, etwas weiter draußen als ChatGPT. Musk sagt, er werde „sofort Maßnahmen ergreifen, um Grok politisch neutraler zu machen“.

ChatGPT wird fauler

In den letzten Tagen haben immer mehr Benutzer berichtet, dass ChatGPT, anstatt eine Aufgabe auszuführen, desinteressiert zu sein scheint oder eine unvollständige Antwort gibt und Benutzer auffordert, die Aufgabe selbst zu erledigen. Für mich ist das ein sicheres Zeichen dafür, dass eine künstliche allgemeine Intelligenz auf menschlicher Ebene erreicht wurde.

Viele vermuten, dass OpenAI es abgeschwächt hat, um die phänomenalen Kosten des Systems zu senken, aber OpenAI sagt, dass dies nicht der Fall ist.

Wir haben Ihr Feedback dazu gehört, dass GPT4 immer fauler wird! Wir haben das Modell seit dem 11. November nicht mehr aktualisiert, und das ist sicherlich nicht beabsichtigt. Modellverhalten kann unvorhersehbar sein, und wir versuchen, es zu beheben 🫡

– ChatGPT (@ChatGPTapp) 8. Dezember 2023

Mittlerweile bestechen Nutzer dazu, die KI mit Tipps für bessere Antworten zu bestechen und ihr gleich in der Eingabeaufforderung einzuprägen, wie umwerfend wichtig die bestmögliche Antwort sei.

Das Gemini-Video von Google war unwirklich

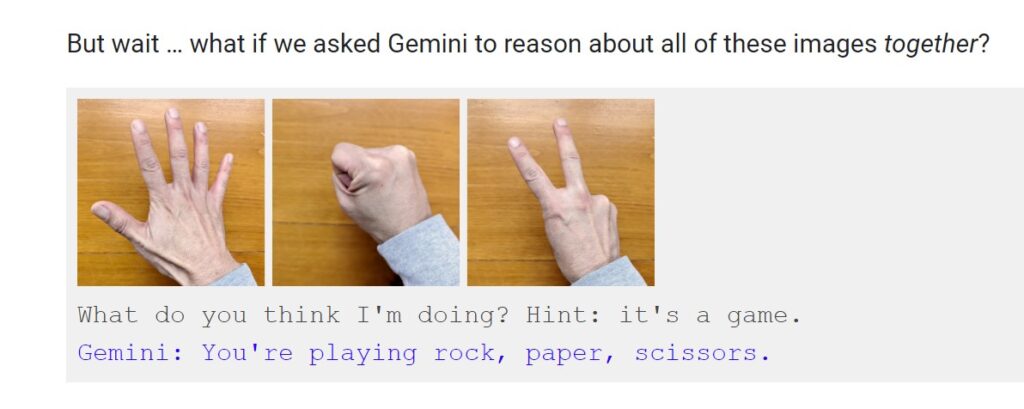

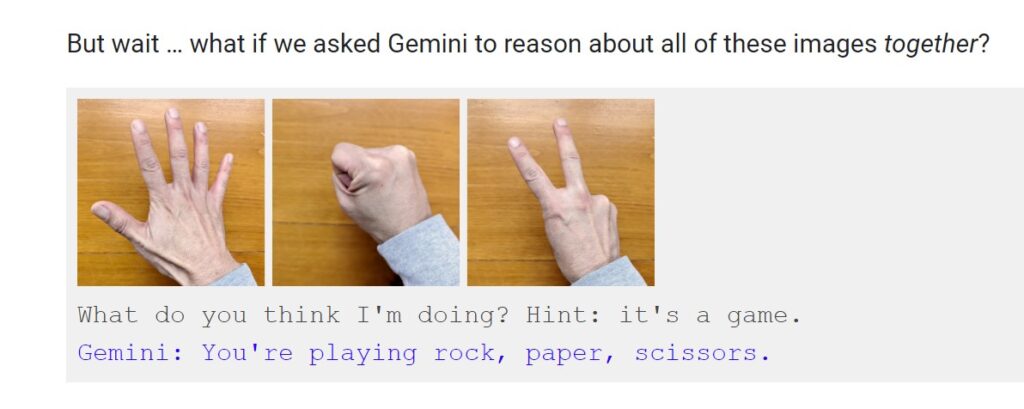

Wie wir jetzt wissen, war Googles „umwerfendes“ und „unwirkliches“ Produktvideo für Gemini Ultra gefälscht – aber ist die Täuschung schwerwiegend?

Das Video zeigt einen Mann, der ein natürlich klingendes Gespräch mit der KI führt, die erkennt, dass er gerade eine Ente zeichnet. Gemini Ultra kann auch während eines Hütchenspiels herausfinden, unter welchem Becher sich der Ball befindet, und herausfinden, wann jemand Stein-Papier-Schere spielt.

Aber in Wirklichkeit gab es kein Video und kein gesprochenes Gespräch. Die KI wurde per Text aufgefordert und lediglich Standbilder angezeigt.

Google sagt jedoch, dass die Eingabeaufforderungen und Ausgaben echt waren und Gemini tatsächlich die Zeichnung einer Ente erkennen kann.

Die Erkennung von Enten ist den Wissenschaftlern lange Zeit entgangen, daher schien dies ein großer Durchbruch zu sein … obwohl ChatGPT tatsächlich auch Enten erkennen kann.

Oriol Vinyals, Vizepräsident für Forschung bei Google DeepMind, sagte, das Video sei lediglich ein Serviervorschlag.

„Das Video veranschaulicht, wie die mit Gemini erstellten multimodalen Benutzererlebnisse aussehen könnten. Wir haben es geschafft, Entwickler zu inspirieren.“

Testergebnisse für Gemini zeigen, dass es GPT-4 in sieben von acht Benchmarks knapp übertrifft – was sich gut anhört, bis man erkennt, dass GPT-4 vor einem Jahr fertiggestellt wurde, was OpenAI einen 12-monatigen Vorsprung gegenüber GPT-5 verschafft.

Fetch.AI = Google der KI-Agenten?

AI Eye traf sich diese Woche mit Humayun Sheikh – dem Gründer von Fetch.ai und ehemaligen kaufmännischen Leiter von DeepMind (jetzt Google DeepMind). Sheikh sagt, das Unternehmen habe „vor 13 Jahren GPT-ähnliche Dinge getan“, was bedeutet, dass Google bewusst beschlossen hat, kein LLM zu veröffentlichen, bis ChatGPT ihn dazu gezwungen hat.

„Ich war ziemlich überrascht, dass es ziemlich spät herauskam und sie OpenAI eine Chance gaben. Aber ich glaube, sie waren schon vor einiger Zeit fertig“, sagt er.

„Das Problem besteht darin, dass man, wenn man anfängt, diese Technologie zu nutzen und sie loslässt, damit beginnt, sein eigenes Geschäft zu kannibalisieren“, fügt er hinzu und spekuliert, dass die KI die Einnahmen aus Googles lukrativem Suchgeschäft untergraben könnte.

Dennoch glaubt Sheikh, dass Google im KI-Wettrüsten immer noch in einer Gewinnerposition ist.

„Google hat Karten, Google hat Werbung, Google hat Unternehmen und die gesamte Reichweite, die Sie für die Integration in eine Reihe von Anwendungen benötigen“, sagt er. „Ich denke also, dass OpenAI ein Problem hat und OpenAI sich drastisch ändern muss, um lebensfähig zu sein.“

Lesen Sie auch

Merkmale

Lernen Sie Dmitry kennen: Mitbegründer des Ethereum-Erfinders Vitalik Buterin

Merkmale

Leitfaden für echte Krypto-OGs, die Sie auf einer Party treffen würden (Teil 2)

Die Aufgabe von Fetch.AI besteht darin, Benutzern bei der Erstellung von KI-Agenten zu helfen. Bisher sind 100.000 davon im Einsatz. Die Bots können bei Reisebuchungen, beim Laden von Elektrofahrzeugen und bei der Betreuung von IoT-Geräten helfen.

Sie können einem KI-Agenten ein Ziel vorgeben, und er erstellt eine Reihe von Teilaufgaben und führt diese autonom aus, bis das Ziel erreicht ist. Sheikh sagt, Blockchain sei eine natürliche Lösung, um Agenten zu koordinieren und ihre Leistung aufzuzeichnen.

„Wenn Sie mit mehreren Entitäten interagieren möchten, wenn Sie mit mehreren Codeteilen interagieren möchten, wenn Sie mit mehreren KI-Algorithmen für maschinelles Lernen interagieren möchten, benötigen Sie ein neues Framework. Das kann man nicht auf einem alten Web 2.0-Framework ausführen.“

„Die Orchestrierung dieser Aufgaben muss irgendwo stattfinden“, sagt er. „Und diese Mikroaufgaben erfordern eine gewisse Monetarisierung, die die Blockchain bietet.“

Peaq Blockchain, Fetch.ai und Bosch haben gerade das Bosch XDK110 Rapid Prototyping Kit vorgestellt, das einen kleinen Sensor verwendet, der Daten über Dinge wie Verschmutzungsgrad, Wetter oder seismische Aktivität erfassen und die Daten dann an mehrere dezentrale physische Infrastrukturen zurückgeben kann Netzwerke (DePINs) im Austausch gegen Token.

DePIN ist derzeit eines der heißesten Narrative und wird in diesem Bullenmarkt eine RIESIGE Chance für Anleger darstellen.

Erkunden Sie diesen Sektor?

– Lark Davis (@TheCryptoLark) 8. Dezember 2023

So könnten Sie beispielsweise einen KI-Agenten bitten, die Reifendrucksensoren in Ihrem Auto und die Sensoren zur Aufzeichnung der Wetterbedingungen zu überprüfen und herauszufinden, ob der Reifendruck zu niedrig oder zu hoch ist oder ob Sie neue Reifen benötigen. Wenn Sie dies tun, kann es Sie am Reifenhändler einbuchen.

Oder Sie könnten Ihren KI-Agenten bitten, eine Stimmungsanalyse für eine bestimmte Aktie durchzuführen und diese zu kaufen, wenn die Analyse positiv ausfällt.

Laut Sheikh soll Fetch.AI zur Suchmaschine für Agenten werden, „und wir werden auch eine Selbstassemblierungsmaschine sein, die all diese Dinge zusammenfügt, ohne dass man sie programmieren oder integrieren muss.“

Alles Killer, keine Füller-KI-Neuigkeiten

– Meta hat 20 neue KI-Funktionen für seine Social-Media-Plattformen eingestellt, um Suche, Anzeigen und Geschäftsnachrichten aufzupeppen. Der kostenlose Bildgenerator ist das, worüber die Leute begeistert sind.

– Boffins von Alibaba haben eine Reihe von TikTok-Influencer-Videos zusammengestellt, und jetzt können Sie Bilder von tanzenden Menschen aus einem Standbild erstellen und einige Posenanleitungen.

— Professor Ethan Mollick hat alle LLMs verglichen und gegenübergestellt und sagt, dass GPT-4 am besten geeignet ist. Untersuchungen deuten darauf hin, dass es die tatsächliche Arbeitsleistung steigert, bessere Ideen hervorbringt als die meisten Menschen, intelligenter zu sein scheint als die Konkurrenz und über die meisten Funktionen verfügt.

— McDonald’s entwickelt einen KI-Chatbot namens Ask Pickles, der auf Daten von 50.000 Restaurants trainiert wird. Franchisenehmer und Mitarbeiter können jetzt die KI befragen, um besser zu verstehen, wie sie alles auf eine McDonalds-ähnlichere Art und Weise erledigen können.

— Bei Amazon arbeiten derzeit rund eine Dreiviertelmillion Roboter mit 1,5 Millionen Mitarbeitern.

– Grok-Benutzer Jax Winterbourne war verblüfft, als die KI sich weigerte, eine Frage zu beantworten, und als Begründung die OpenAI-Richtlinie anführte. Während einige Benutzer glauben, dass sich Grok lediglich als Frontend für ChatGPT herausgestellt hat, sagte Xai, dass es einige der Ergebnisse von ChatGPT in seinen Trainingsdaten aufgegriffen habe.

Tweet der Woche

Eine neue Perspektive ist gerade aufgetaucht: „Das Einzige, was LLMs tun, ist zu halluzinieren. Der Trick besteht darin, die Halluzinationen mit der Realität in Einklang zu bringen.“

# Zum „Halluzinationsproblem“

Ich habe immer ein bisschen Probleme damit, wenn ich nach dem „Halluzinationsproblem“ bei LLMs gefragt werde. Denn in gewissem Sinne ist Halluzination alles, was LLMs tun. Es sind Traummaschinen.

Wir lenken ihre Träume mit Anregungen. Die Aufforderungen beginnen den Traum und basierend auf dem…

— Andrej Karpathy (@karpathy) 9. Dezember 2023

Abonnieren

Die spannendsten Lektüre in der Blockchain. Wird einmal pro Woche geliefert.

Andrew Fenton

Andrew Fenton lebt in Melbourne und ist Journalist und Redakteur für Kryptowährungen und Blockchain. Er hat als nationaler Unterhaltungsautor für News Corp Australia, als Filmjournalist bei SA Weekend und bei The Melbourne Weekly gearbeitet.

Folgen Sie dem Autor @andrewfenton